SQL Server存储过程插入50万测试数据缓慢问题剖析与存储引擎优化浅谈

在SQL Server中,当使用存储过程结合事务处理插入50万条测试数据时,如果遇到速度异常缓慢的情况,这通常不仅仅是简单的代码逻辑问题,而是涉及到底层存储引擎、数据处理策略以及事务管理机制等多方面的综合因素。本文将浅析其原因,并提供相应的优化思路。

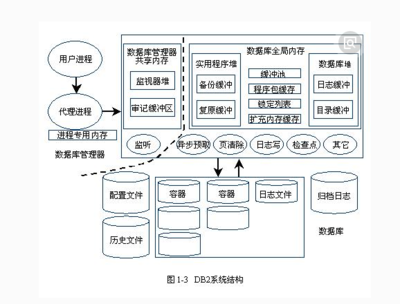

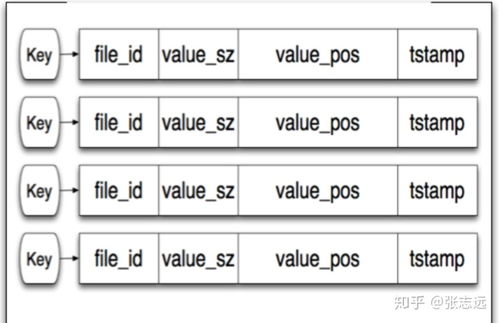

一、存储引擎与数据写入机制

SQL Server的核心存储引擎负责数据的物理存储、缓存管理和事务日志记录。当执行大批量插入时,以下几个环节可能成为瓶颈:

- 事务日志写入:默认情况下,每个插入操作都会产生日志记录,以保证事务的ACID特性。频繁的日志写入(尤其是物理磁盘I/O)会极大拖慢速度。

- 锁与并发控制:在事务内逐条插入,可能会导致大量的行级或页级锁竞争,增加系统开销。

- 索引维护:如果目标表存在索引,尤其是聚集索引,每次插入都可能触发索引的重排与分裂,消耗大量资源。

二、常见性能瓶颈与优化策略

针对上述问题,可以考虑以下优化措施:

- 批量提交事务:不要将50万条插入放在单个大事务中,这可能导致日志文件暴涨和长时间锁持有。可以分批次提交,例如每1000或10000条提交一次,以平衡数据完整性与性能。

- 使用批量插入方法:考虑使用

INSERT INTO ... SELECT、BULK INSERT或SqlBulkCopy(.NET环境)等批量操作,这些方法相比逐条插入能显著减少日志量和锁开销。 - 临时禁用索引与约束:在插入前,非聚集索引可以暂时禁用(

ALTER INDEX ... DISABLE),插入完成后再重建。但需谨慎评估数据一致性风险。 - 调整恢复模式:如果测试环境允许,可以将数据库恢复模式设置为“简单”(SIMPLE),以减少日志记录量。生产环境需根据备份策略决定。

- 优化表结构与存储:确保表设计合理,例如使用适当的填充因子、分区表(Partitioning)来分散I/O压力。

三、数据处理与存储务的实践建议

从更宏观的“数据处理和存储务”角度看,高效的数据处理不仅依赖于数据库本身的优化,还需要结合业务逻辑和架构设计:

- 异步与并行处理:如果业务允许,可以将数据插入任务拆分为多个并行执行的存储过程或作业,充分利用多核CPU资源。

- 资源监控与调优:使用SQL Server Profiler、扩展事件或DMV(动态管理视图)监控插入过程中的等待类型(如PAGEIOLATCH、WRITELOG),针对性调整磁盘配置(如使用SSD、分离数据与日志文件到不同物理驱动器)。

- 代码层面优化:在存储过程中,避免在循环内执行查询或复杂计算;使用表变量或临时表暂存数据,再一次性插入。

四、示例优化代码片段

以下是一个改进后的存储过程思路,采用分批插入与最小化日志操作:`sql

CREATE PROCEDURE InsertTestData

AS

BEGIN

SET NOCOUNT ON;

DECLARE @BatchSize INT = 5000, @Count INT = 0;

WHILE @Count < 500000

BEGIN

BEGIN TRANSACTION;

INSERT INTO TargetTable (Col1, Col2, ...)

SELECT TOP (@BatchSize) ... FROM TestDataSource; -- 假设有数据源

SET @Count += @BatchSize;

COMMIT TRANSACTION;

CHECKPOINT; -- 在简单恢复模式下可帮助清理日志

END

END`

处理海量数据插入时,单纯依赖事务并不能保证性能。深入理解SQL Server存储引擎的工作原理,结合合理的批处理、索引管理和系统资源配置,才能实现数据处理与存储任务的高效执行。在测试阶段,建议模拟真实环境压力,持续监控并调整策略,以达到最优的吞吐量与稳定性。