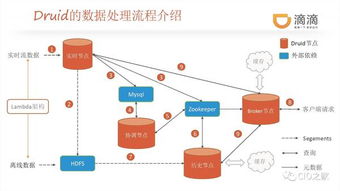

滴滴业务实时监控系统架构及实践 数据处理与存储篇

在滴滴这样业务规模庞大、场景复杂的出行平台,实时监控系统是保障服务稳定性、提升运营效率与用户体验的核心基础设施。其数据处理与存储架构的设计,直接决定了监控的时效性、准确性与可靠性。本文将深入探讨滴滴业务实时监控系统中,数据处理与存储环节的关键架构设计与工程实践。

一、 数据处理架构:流批一体的实时计算引擎

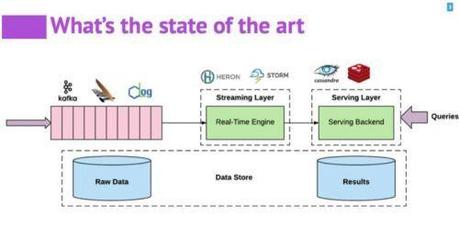

滴滴的实时监控数据处理架构,核心是构建了一套高吞吐、低延迟、高可用的流批一体化数据处理流水线。

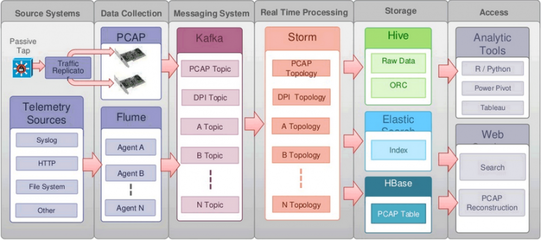

- 数据采集与接入层:系统通过部署在服务端、客户端(司机与乘客端)以及基础设施层的Agent,持续采集海量指标、日志与追踪数据。这些数据通过统一的数据接入网关(如Kafka集群)进行汇聚,实现了数据的解耦与缓冲,为下游处理提供稳定的数据流。

- 实时计算层:这是数据处理的核心。滴滴采用了以Flink为核心的流式计算引擎,对原始数据流进行实时清洗、过滤、聚合与关联分析。

- 清洗与标准化:对异构来源的数据进行格式统一、无效数据剔除和字段补全,形成标准化的监控事件。

- 窗口聚合计算:针对业务指标(如订单成功率、响应时间P99、区域运力供需比),系统定义了多种时间窗口(如1分钟、5分钟滑动窗口)进行实时聚合,快速计算出当前业务状态。

- 复杂事件处理(CEP):通过预定义规则,对多个数据流中的事件进行关联与模式识别,用于发现复杂的故障场景,例如:某个地理区域的司机接单成功率骤降,同时该区域网络延迟飙升,可能预示着网络基础设施问题。

- 批处理与数据补充:为了得到更全面、准确的分析视图,系统会周期性地(如每小时、每天)启动Spark等批处理作业,对历史数据进行深度聚合、统计分析,并与离线数据仓库(如Hive)中的业务维度数据(如城市信息、车型信息)进行关联,丰富监控数据的业务上下文。流批结果的融合,使得监控看板既能展示秒级更新的实时态势,也能提供基于长周期数据的趋势分析。

二、 数据存储架构:多模分层与智能降级

面对每秒数百万甚至上千万数据点的写入与查询压力,滴滴的监控数据存储采用了多模(Multi-Model)、分层的策略,针对不同数据生命周期和查询需求选择最优存储方案。

- 热数据存储:时序数据库(TSDB)为核心

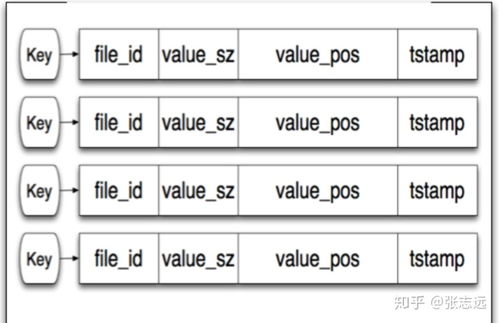

- 经过处理的核心实时指标(如最近24小时),被写入高性能的时序数据库,如OpenTSDB或其自研优化版本。时序数据库针对时间序列数据的高并发写入和按时间范围查询进行了深度优化,能够毫秒级响应监控告警规则的判断和大屏实时刷新。

- 近期的明细日志和追踪数据(如调用链Span)会存入Elasticsearch,以支持灵活的全文检索和多维度下钻分析,便于工程师在出现问题时快速定位根因。

- 温数据与冷数据存储:对象存储与数据湖

- 超过一定时间(如7天)的明细数据,会从在线存储(如ES)转移到成本更低的对象存储(如HDFS、S3)或数据湖中。这些数据依然可用于历史问题复盘、离线分析报表生成以及模型训练。

- 长期的历史聚合指标数据,则会进一步归档至列式存储数据库(如ClickHouse)或数据仓库,支撑宏观的业务趋势分析、容量规划等场景。

- 存储优化与降级策略

- 数据压缩与采样:针对不同精度的需求,对历史数据采用有损压缩(如降采样)和无损压缩相结合的方式,在可接受的精度损失下大幅降低存储成本。

- 智能分级存储:系统根据数据的访问热度,自动在不同存储介质间迁移数据,确保热数据高速访问,冷数据低成本存储。

- 降级与高可用:存储层具备多机房容灾能力。在极端情况下,系统可暂时降级为仅存储关键聚合指标,舍弃部分明细数据,优先保障核心监控与告警功能不中断。

三、 核心实践与挑战应对

- 数据质量保障:建立了端到端的数据质量监控体系,对数据延迟、丢失、重复、准确性进行监测和告警,确保监控数据本身的可靠性。

- 成本与效率的平衡:通过精细化的数据生命周期管理、存储格式优化(如使用Parquet/ORC)以及计算资源弹性调度,在满足业务需求的前提下,持续优化资源使用效率,控制总体成本。

- 应对峰值洪流:在节假日或大型活动期间,订单量可能激增数倍。系统通过动态扩缩容计算与存储集群、提前预计算关键指标、设置柔性熔断机制(如短暂丢弃非核心指标的极细粒度数据)等方式,平稳应对流量洪峰。

- 统一数据服务:对外提供统一的数据查询服务层,封装底层存储的复杂性,为告警引擎、可视化大屏、分析平台等消费方提供一致、高效的查询接口。

###

滴滴业务实时监控系统的数据处理与存储架构,是一个在不断演进中形成的复杂系统工程。它融合了流批一体计算、多模分层存储、智能降级等先进理念,并通过严谨的工程实践应对了规模、复杂度与成本的多重挑战。这套体系不仅保障了滴滴全球业务的稳定运行,也为行业在构建超大规模实时监控系统方面提供了宝贵的实践经验。随着AIOps的深入,实时数据流将与智能分析预测更紧密地结合,驱动监控系统向自动化、智能化运维决策方向持续演进。

最新产品

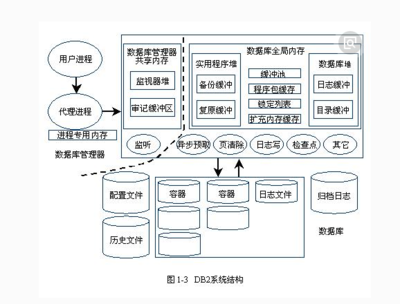

数据库需求分析中的数据处理与存储任务

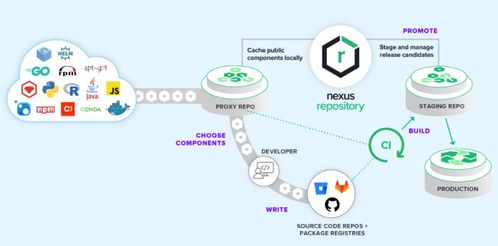

DevOps制品管理 超越存储,迈向数据处理与智能化的核心枢纽

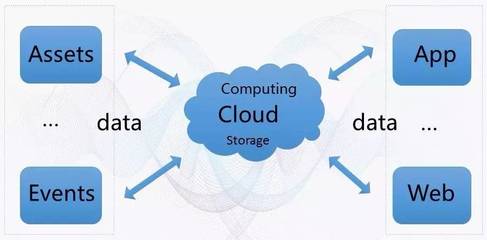

大数据的14个基础概念,用大白话教你搞懂数据处理与存储

数据处理与存储安全 驱动网络安全产业迈向2500亿规模新纪元

元力股份以4500万元转让广州原力100%股权,全面剥离网游资产聚焦数据处理与存储主业

全新版本MongoDB 为物联网数据处理与存储注入强劲动力

自行搭建威胁感知大脑SIEM 数据处理与存储实践

开源实时数据处理系统Pulsar 一站式融合Kafka、Flink与数据库功能的数据处理与存储解决方案

SQL Server存储过程插入50万测试数据缓慢问题剖析与存储引擎优化浅谈

SQL Server中存储过程、触发器、事务处理及数据处理与存储务综合应用